Open WebUI インストール2024/06/04 |

|

LLM を WebUI から実行可能な Open WebUI をインストールします。 Open WebUI は pip3 でもインストールできますが、当例ではコンテナーで起動します。 |

|

| [1] | |

| [2] | |

| [3] | Open WebUI のコンテナーイメージを Pull して起動します。 |

|

[root@dlp ~]# podman pull ghcr.io/open-webui/open-webui:main [root@dlp ~]# podman images REPOSITORY TAG IMAGE ID CREATED SIZE ghcr.io/open-webui/open-webui main a48d0a909833 3 hours ago 3.58 GB

[root@dlp ~]#

[root@dlp ~]# podman run -d -p 3000:8080 --add-host=host.containers.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

podman ps CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES efc2886a7f58 ghcr.io/open-webui/open-webui:main bash start.sh 6 seconds ago Up 6 seconds 0.0.0.0:3000->8080/tcp open-webui |

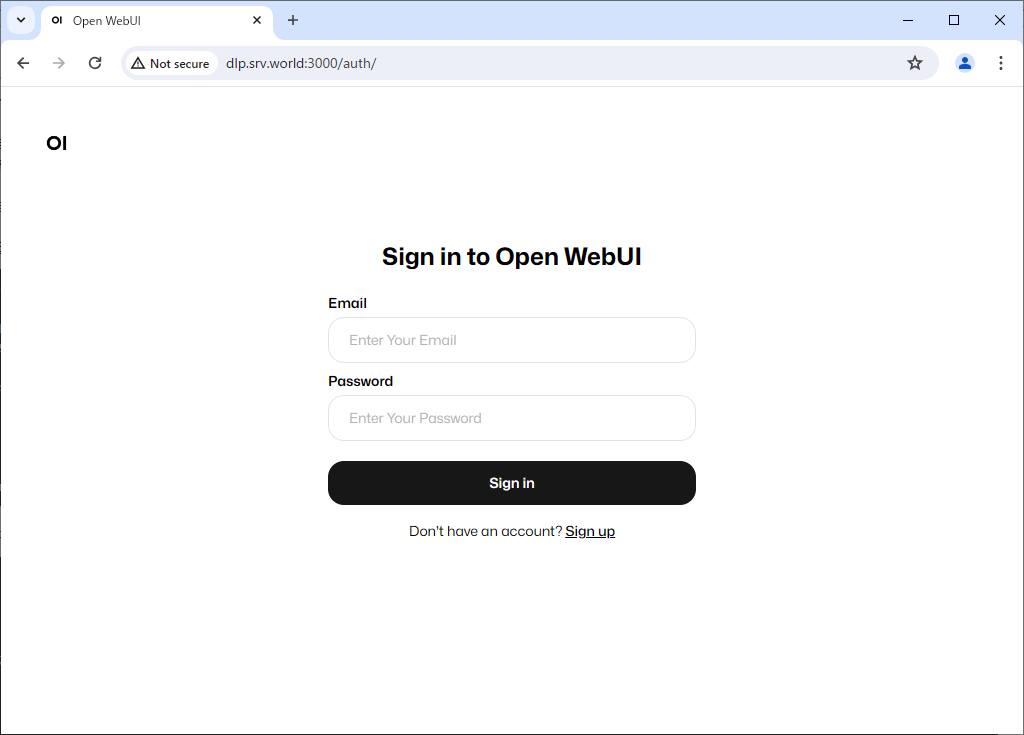

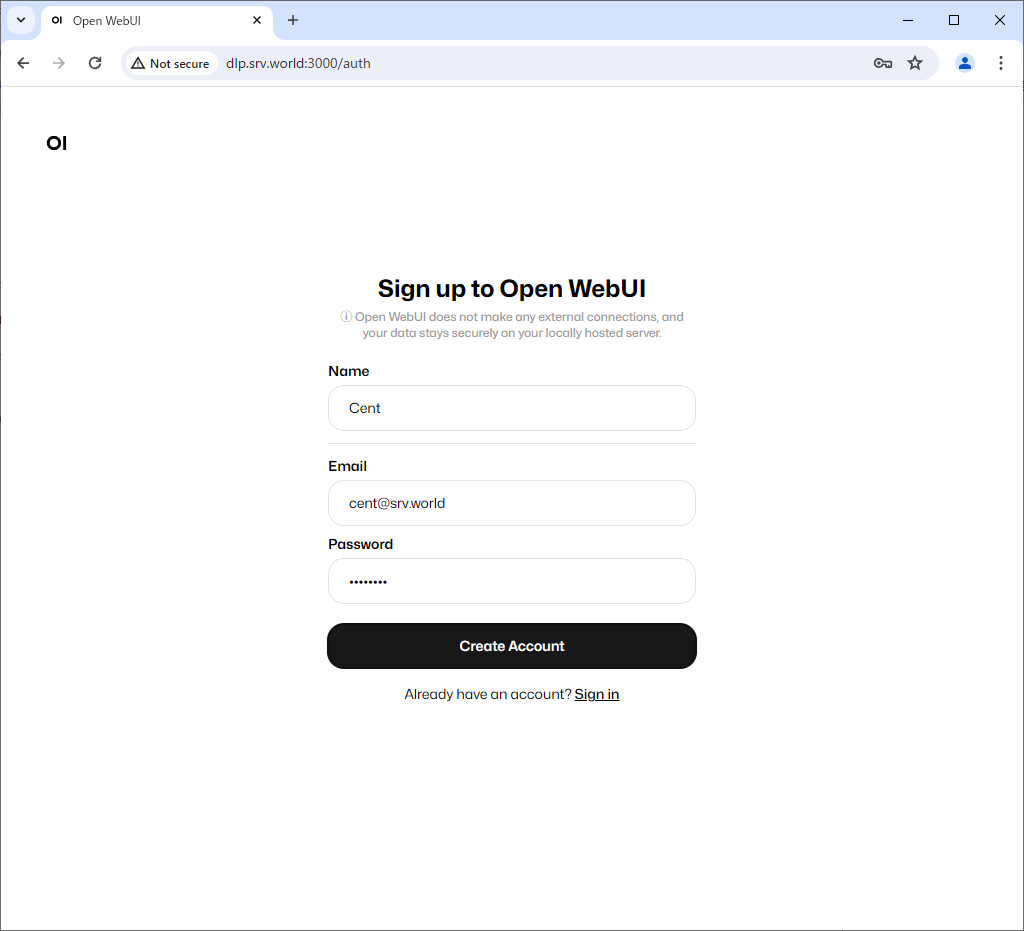

| [4] | 任意のクライアントコンピューターで Web ブラウザーを起動し、アプリケーションにアクセスして動作確認します。 アクセスすると以下の画面になるので、初回アクセス時は [Sign up] をクリックしてユーザー登録します。 |

|

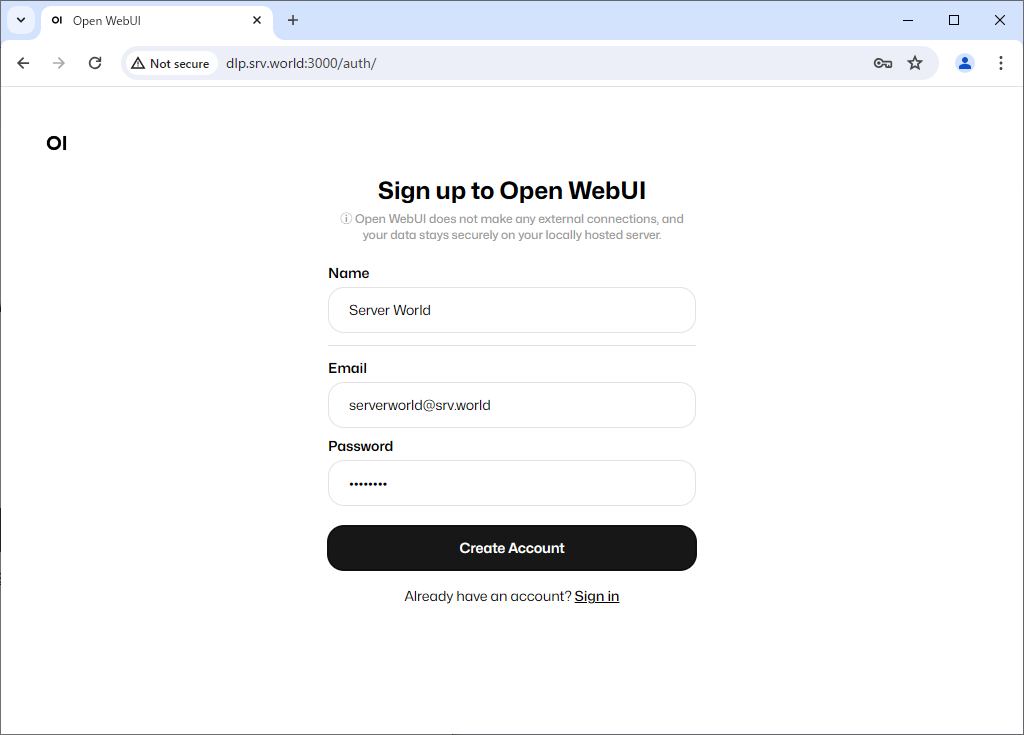

| [5] | 必要な項目を入力して [Create Account] をクリックします。初めて登録したユーザーは自動的に管理者アカウントとなります。 |

|

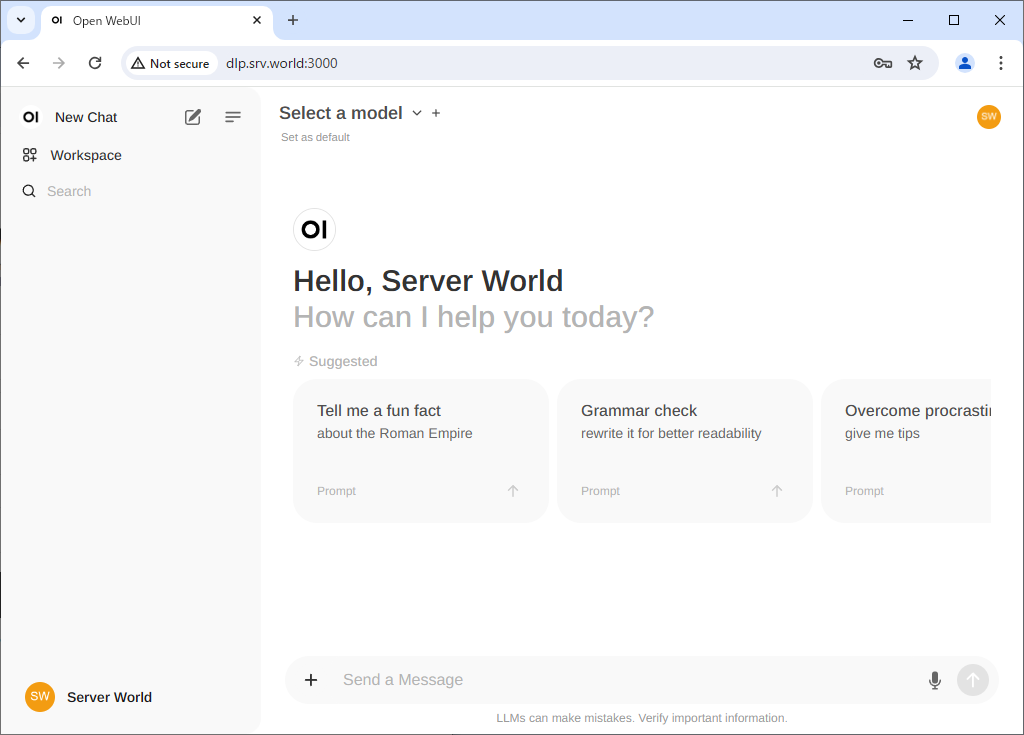

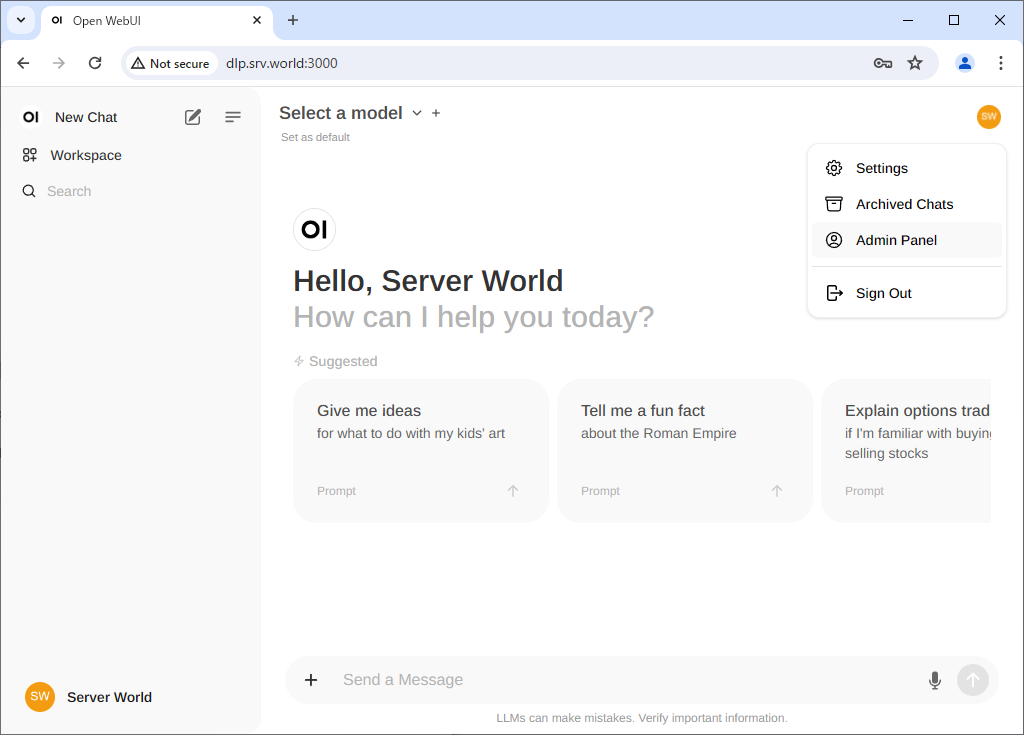

| [6] | アカウントが作成されると、Open WebUI のデフォルトページが表示されます。 |

|

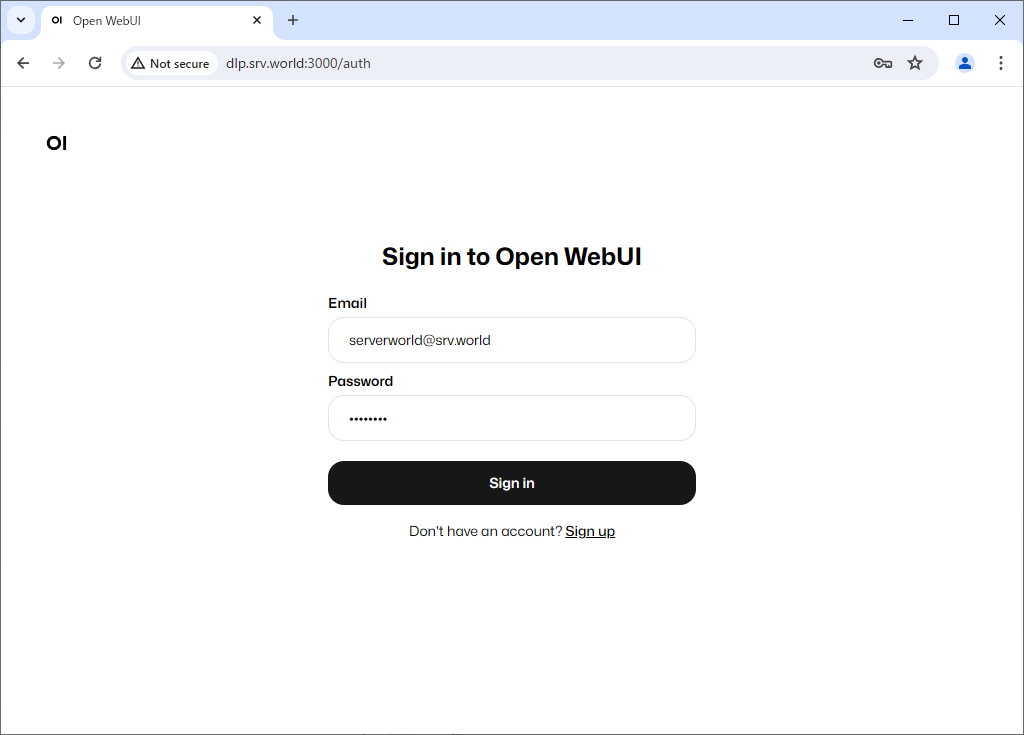

| [7] | 次回からは、登録したメールアドレスとパスワードでログイン可能です。 |

|

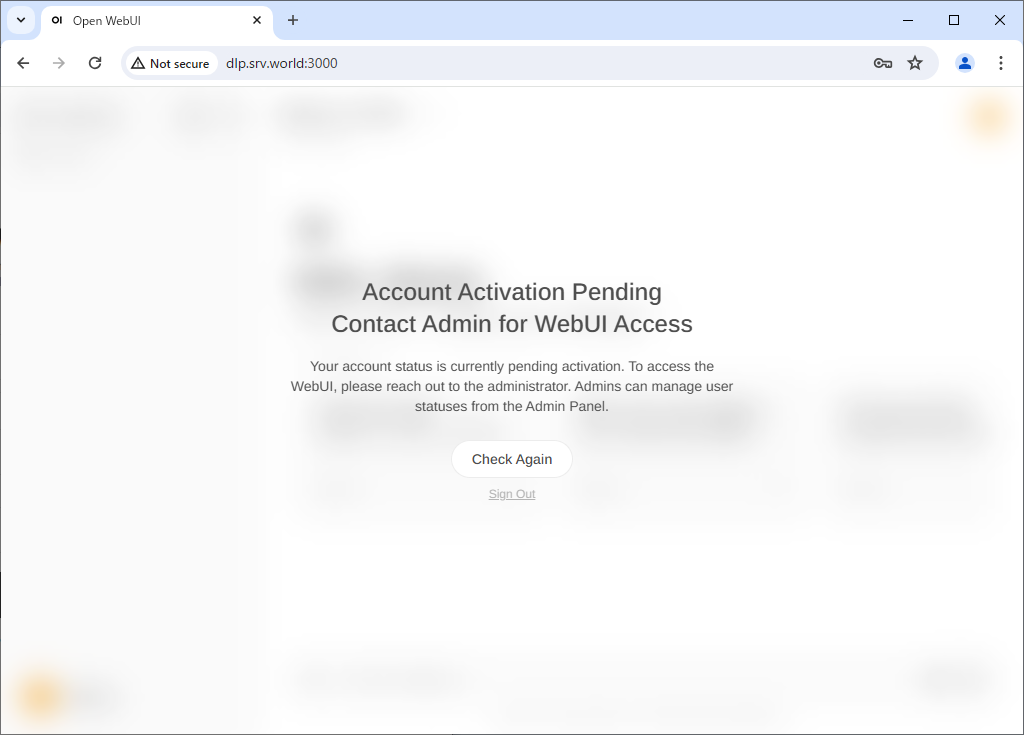

| [8] | 2 人目以降のユーザーは、 [Sign up] からユーザー登録すると、アカウントは Pending 状態になり、管理者アカウントで承認する必要があります。 |

|

|

| [9] | 新規ユーザーを承認するには、管理者アカウントでログイン後、右上のメニューから [Admin Panel] をクリックして移動します。 |

|

| [10] | [Pending] 中のユーザーは、[pending] をクリックすると、承認済みとなります。再度 [user] をクリックすると、[Admin] に昇格させることができます。 |

|

|

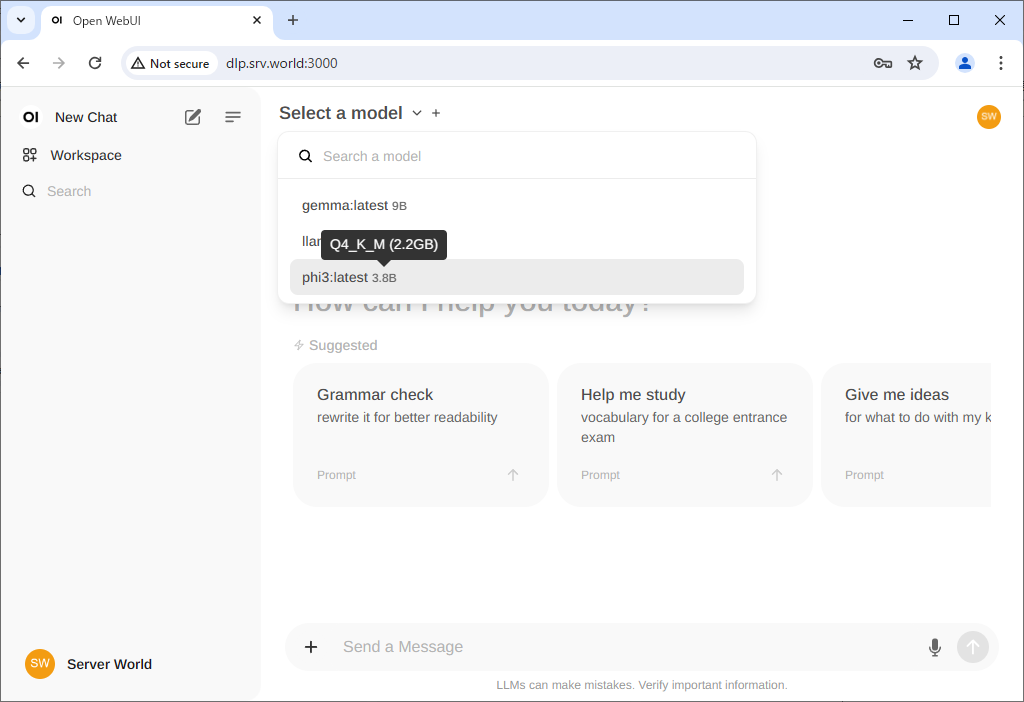

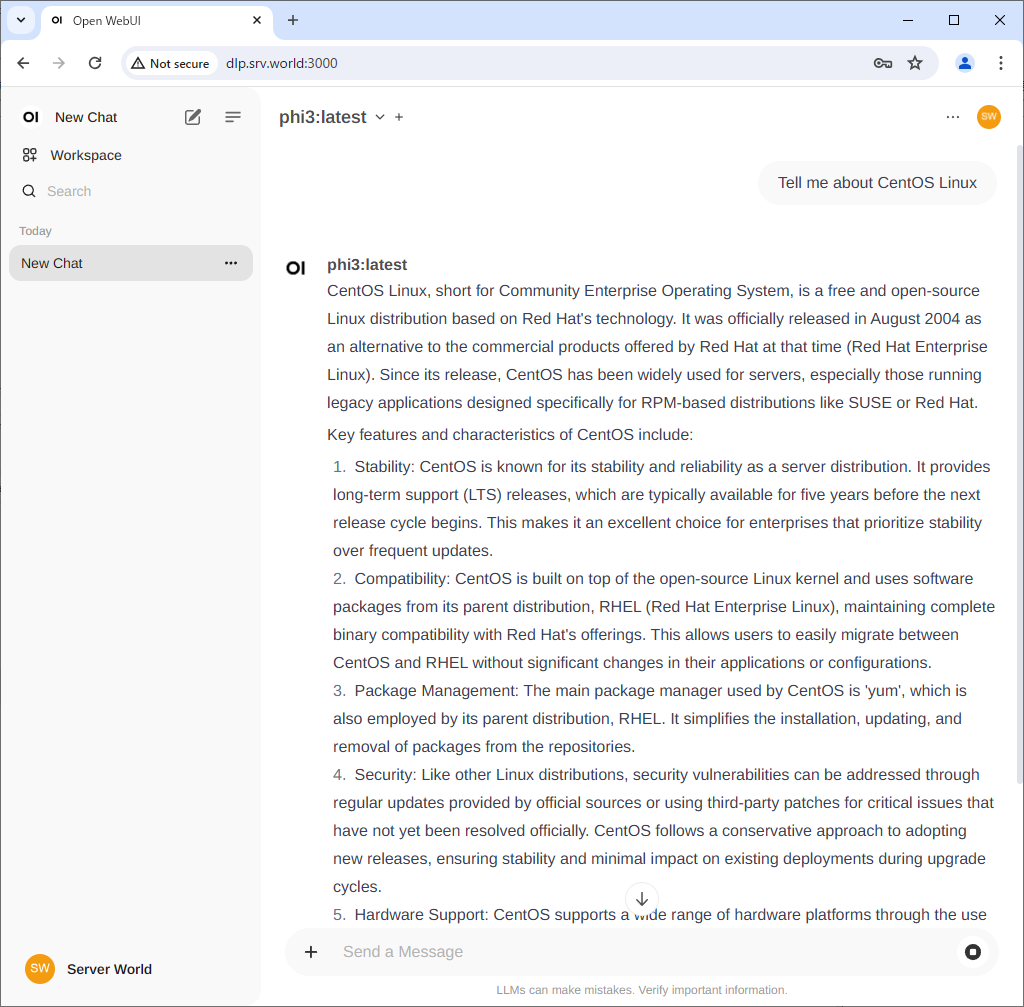

| [11] | Chat を利用するには、上部メニューから Ollama に読み込ませたモデルを選択して、下段にメッセージを入力すると、返答が返ってきます。 |

|

|

関連コンテンツ